لنر إن كان الروبوت قاضيا عادلا

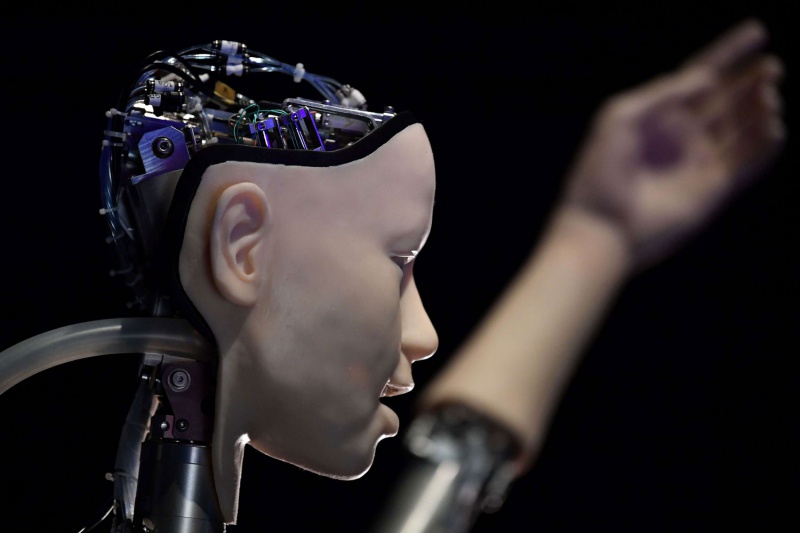

من الروبوت “دو نوت باي” الشهير، إلى القضاة الآليين للفصل في الدعاوى الصغيرة والروبوتات الوسطاء، وصولا إلى القضاة المعتمدين فإن الذكاء الاصطناعي يتسلل إلى قاعات المحاكم، فهل ينشر العدل؟

رينا شاندران

عمل حامد إسماعيل في سلك المحاماة لأكثر من عشرين سنة. وأصبحت جل القضايا تمر من أمامه بنسق عادي دون أي مفاجآت، لكنه صُدم عندما حُكم على رجل يدافع عنه في ولاية صباح الماليزية بمساعدة أداة ذكاء اصطناعي.

وكان إسماعيل يعلم أن المحاكم في مدينة صباح وفي ساراواك المجاورة كانت تختبر أداة الذكاء الاصطناعي لتوصيات إصدار الأحكام كجزء من تجربة وطنية، لكنه لم يكن مطمئنا لاستخدام التكنولوجيا قبل أن يفهمها المحامون والقضاة والجمهور تماما ويتخذون قرارا بشأنها.

مخاوف مشروعة

حامد إسماعيل: الذكاء الاصطناعي لا يمكنه استخدام تقييمات تقديرية

أكّد إسماعيل غياب أي جهة تقدم استشارة قانونية مناسبة حول استخدام التكنولوجيا، وأن دراستها بالتالي لا تعتبر كافية في إطار قانون العقوبات المُعتمد في البلاد. وقال إن “قانون الإجراءات الجنائية هذا لا ينص على استخدام الذكاء الاصطناعي في المحاكم… أعتقد أن الأمر غير دستوري”، مضيفا “أن العقوبة التي أوصت بها أداة الذكاء الاصطناعي والمتعلقة بموكله المتهم بحيازة كمية بسيطة من المخدرات كانت قاسية جدا ولا تتناسب مع حجم الجرم”.

وكانت محاكم صباح وساراواك قد قررت تجربة برنامج طورته شركة ساراواك لأنظمة المعلومات، وهي شركة حكومية تابعة للدولة قالت في ذلك الوقت إنها أجرت مشاورات أثناء العملية واتخذت خطوات لمعالجة بعض المخاوف التي أثيرت.

ولا يقتصر استخدام الذكاء الاصطناعي على المحاكم في ماليزيا، ويشهد الكثير من نظم العدالة الجنائية في جميع أنحاء العالم تزايدا متسارعا لتوظيف مثل هذه الأدوات، من تطبيق محامي روبوت الدردشة “دو نوت باي” الشهير، إلى القضاة الآليين في أستونيا المُعتمدين للفصل في الدعاوى الصغيرة، والروبوتات الوسطاء في كندا، والقضاة المعتمدين للذكاء الاصطناعي في المحاكم الصينية.

وتقول السلطات إن الأنظمة القائمة على الذكاء الاصطناعي تساهم في إبقاء الأحكام أكثر اتساقا ويمكنها مراجعة القضايا المتراكمة بسرعة وبتكلفة زهيدة، مما يساعد جميع الأطراف على تجنب التقاضي المطول والمكلف والمرهق.

وأشار أكثر من ثلث المستجوبين الحكوميين في استطلاع عالمي أجرته شركة الأبحاث غارتنر العام الماضي إلى أنهم يخططون لزيادة الاستثمارات في الأنظمة التي تعمل بالذكاء الاصطناعي، بما في ذلك روبوتات الدردشة والتعرف على الوجه واستخراج البيانات.

وتخطط السلطات الفدرالية الماليزية هذا الشهر إلى الانتهاء من تجاربها على مستوى البلاد لأدوات وظيفتها إصدار الأحكام باعتماد الذكاء الاصطناعي، والتي يقولون إنها “يمكن أن تحسن جودة الحكم”، على الرغم من أن خطط استخدامها في المحاكم ليست واضحة.

وقال متحدث باسم رئيس القضاة في ماليزيا إن استخدام الذكاء الاصطناعي في المحاكم “لا يزال في المرحلة التجريبية”، رافضا الدخول في التفاصيل.

عوامل التحيّز

التشجيع الذي يحظى به استخدام هذه الأدوات من قبل البعض يواجه أيضا بالخشية والحذر من البعض الآخر، ويحذر المنتقدون من أن الذكاء الاصطناعي قد يؤدي إلى ترسيخ التحيز ضد الأقليات والفئات المهمشة ويزيد من آثارها السلبية. ويقول أصحاب هذا الرأي إن التكنولوجيا تفتقر إلى قدرة القضاة على تقييم الظروف الفردية لكل قضية، أو التكيف مع الأعراف الاجتماعية المتغيرة.

وركز إسماعيل على العامل الشخصي وقال “عند إصدار الأحكام، لا ينظر القضاة فقط في وقائع القضية، بل يفكرون في العوامل المحيطة بالجريمة ويقدرون الحكم الأفضل حسب كل سياق، لكن الذكاء الاصطناعي لا يمكنه استخدام التقييمات التقديرية المبنية على مثل هذه العوامل”.

وقال المحامي الماليزي المعني بحقوق الإنسان تشارلز هيكتور فيرنانديز إن النظر في العوامل المشددة للحكم أو المخففة له “يتطلب عقلا بشريا. حيث تختلف الأحكام باختلاف الزمان وتغير الرأي العام. ونحن بحاجة إلى المزيد من القضاة والمدعين العامين للتعامل مع القضايا المتزايدة. لا يمكن أن يحل الذكاء الاصطناعي محل القضاة البشريين في المستقبل القريب”.

وقالت شركة ساراواك لأنظمة المعلومات إنها أزالت متغير “العرق” من الخوارزمية لمعالجة المخاوف من أن يؤدي برنامج الذكاء الاصطناعي الذي طورته إلى إصدار أحكام متحيزة ضد المتهمين.

ولكن، في حين أن “مثل هذه الإجراءات المخففة ذات قيمة، إلا أنها لا تجعل النظام مثاليا”، وفقا لتقرير تقييمي صدر حول الأداة عام 2020 من قبل معهد أبحاث “الخزانة”، وهو مركز أبحاث سياسي.

وأشار المعهد خصوصا إلى أن الشركة لم تستخدم سوى مجموعة بيانات مدتها خمس سنوات، امتدت من عام 2014 إلى عام 2019 لتدريب الخوارزمية “والتي تبدو محدودة إلى حد ما مقارنة مع قواعد البيانات الواسعة المستخدمة في الجهود العالمية”.

وتعذّر الوصول إلى المسؤولين في شركة ساراواك للتعليق على ما إذا كانت الشركة قد وسعت قاعدة بياناتها منذ ذلك الحين.

وأظهر تحليل أجراه المعهد لقضايا في صباح وساراواك أن القضاة اتبعوا توصية إصدار الأحكام الصادرة عن الذكاء الاصطناعي في ثلث القضايا، وكان جميعها متعلقا بقضايا اغتصاب أو حيازة مخدرات. وقرر بعض القضاة تخفيض الأحكام المقترحة في ضوء العوامل المخففة، وشددوا أحكاما أخرى على أساس أنها لن تكون “قوة ردع كافية”.

خوارزمية مبهمة

تشارلز فيرنانديز: العوامل المشددة أو المخففة للحكم تتطلب عقلا بشريا

قال أستاذ القانون في جامعة سنغافورة الوطنية سايمون تشيسترمان إن للتكنولوجيا القدرة على تحسين الكفاءة في نظام العدالة الجنائية. وأضاف أن شرعيتها تعتمد على دقة القرارات وطريقة اتخاذها.

وتابع تشيسترمان كبير المديرين في إي.آي سنغافورة، وهو برنامج حكومي “قد تحيل السلطات القضائية سلطة اتخاذ العديد من القرارات بشكل صحيح إلى الأدوات الذكية، لكن لا ينبغي للقاضي الاستعانة بخوارزمية غير شفافة في كل القضايا”.

كما أعرب مجلس نقابة المحامين في ماليزيا عن قلقه أيضا بشأن برنامج الذكاء الاصطناعي التجريبي. فعندما بدأت المحاكم في العاصمة كوالالمبور في استخدامه منتصف عام 2021 لإصدار أحكام في 20 نوعا من الجرائم، قال المجلس إنه “لم تُقدّم إرشادات على الإطلاق، ولم تتح لنا الفرصة للحصول على تعليقات المجرّبين من ممارسي القانون الجنائي”.

وقد استأنف إسماعيل الحكم الصادر بحق موكله من أداة الذكاء الاصطناعي التي اتبعها القاضي، لكنه قال إن العديد من المحامين لن يخوضوا هذا التحدي عند الحكم على موكليهم بأحكام قاسية للغاية. واعتبر أن آلية الذكاء الاصطناعي تتصرف كقاض كبير. ويخشى أن يعتقد القضاة الشباب أن هذا هو القرار الأفضل ويقبلونه دون أن يوجهوا لأنفسهم أي سؤال حول مدى صحته.