التزييف العميق ألغام افتراضية تنفجر في أي مكان من العالم وعلى أيّ كان من المشاهير

تطورت التطبيقات التكنولوجية التي تتعلق بالصوت والصورة التي تستخدم عادة في السينما والتلفزيون، ويستعملها البعض للتسلية على مواقع التواصل الاجتماعي، لكن هذه التطبيقات تشكل خطورة في تأثيرها على الرأي العام إذا ما استعملت للتضليل والمغالطة وقلب الحقائق وهو ما يسمى بالتزييف العميق.

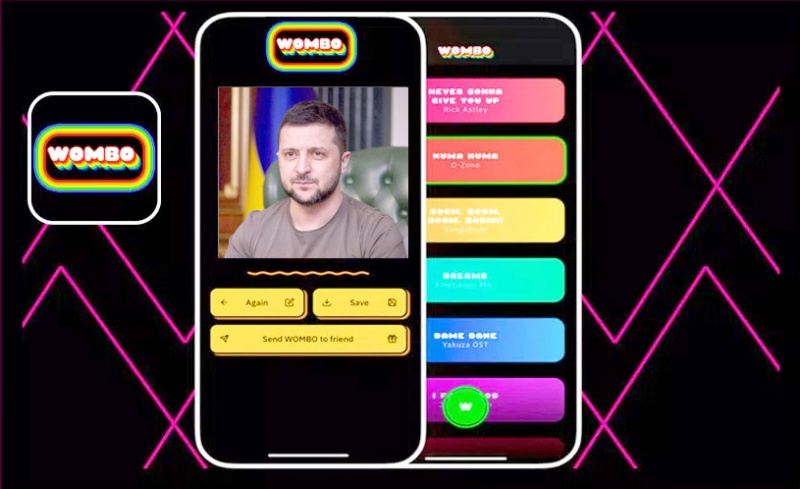

لندن – يبرز التداول الأخير لمقطع فيديو مزور للرئيس الأوكراني فولوديمير زيلينسكي مخاطر استغلال الجهات الفاعلة للتزييف العميق وأشكال أخرى من المحتوى السمعي البصري باعتماد الذكاء الاصطناعي في مجموعة متنوعة من الهجمات المختلفة، بما في ذلك حملات التأثير والابتزاز وسرقة الهوية، ما يعتبر حقل ألغام افتراضيا له عواقب خطيرة على تقصي الحقائق.

وفي السادس عشر من مارس أزالت شركة ميتا التي تتخذ من الولايات المتحدة مقرا لها والتي كانت تُعرف سابقا باسم فيسبوك ويوتيوب مقطع فيديو يزعم أنه لزيلينسكي وهو يدعو الأوكرانيين إلى إلقاء أسلحتهم.

وذكرت مدوّنة إنغادجيت المتخصصة في تغطية الأخبار التقنية أن الفيديو يندرج ضمن ما يسمى “التزييف العميق” في نفس اليوم الذي صدر فيه.

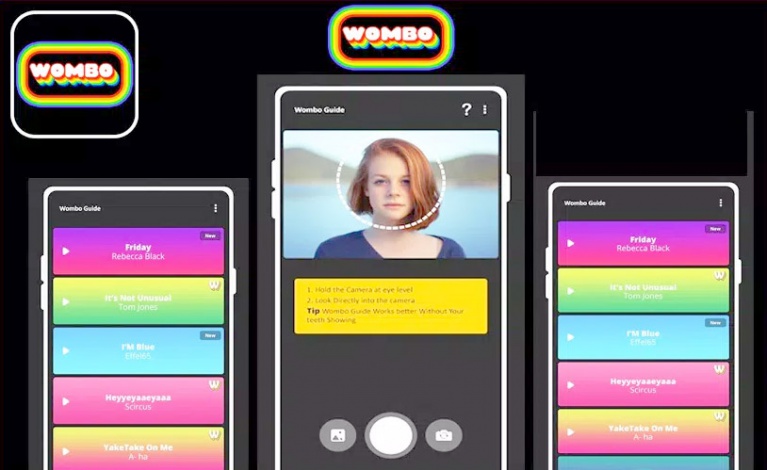

وومبو تطبيق يُمكّن المستخدمين من تحويل صورة أي شخصية إلى فيديو بتحريك الشفاه بالتزامن مع الكلام أو الموسيقى

وتستخدم مقاطع الفيديو في التزييف العميق خوارزميات الذكاء الاصطناعي لإنشاء الصوت والصور والفيديو لقلب الحقائق.

والتزييف العميق مصطلح يستخدم عادة لوصف المحتوى الذي يكون إنشاؤه بغرض تضليل الجماهير وتصوير ما لم يحدث، على عكس التأثيرات المرئية في التلفزيون وصناعة السينما.

وقال رئيس السياسات الأمنية في شركة ميتا المالكة لفيسبوك ناثانيال غلايشر إن المنصة استطاعت التعرف على فيديو منتج بهذه التقنية، يزعم أصحابه أنه يظهر الرئيس الأوكراني زيلينكسي وهو يعطي تصريحا لم يسبق له أبدا الإعلان عنه.

وتابع المتحدث أن الفيديو ظهر في موقع إلكتروني أولا ثم انتشر على الإنترنت. وأضاف أن مقطع الفيديو انتهك سياسات الموقع وسرعان ما حُذف من المنصة بعد مراجعته.

كشف التزييف

على الرغم من التفطّن إلى أن مقطع الفيديو الذي يصور زيلينسكي كان نتاج تزييف عميق منخفض الجودة، غير أن الخطر لم يتوقف على نشر الفيديو المفبرك على مواقع التواصل، بل أكدت القناة الأوكرانية “أوكرانيا 24” أن قراصنة استطاعوا إرسال خبر الفيديو إلى شريط الأخبار الذي يظهر أسفل الشاشة، كما استطاعوا بث جزء منه على المباشر.

ومع التقدم التكنولوجي سيصبح من الصعب على البشر اكتشاف أنهم يشاهدون أو يستمعون إلى محتوى مزيّف. وتعددت الدلائل على أن فيديو زيلينسكي لم يكن حقيقيا.

أولا، كان الفيديو منخفض الدقة لتسهيل إخفاء التشوهات الواضحة، فظهر تفاوت بين لون البشرة على رقبة زيلينسكي ووجهه، كما بدت اللهجة غريبة في الفيديو، وذلك بسبب اعتماد طاقة حوسبة وذكاء اصطناعي أقل تقدما.

وثانيا، لم يحرك زيلينسكي ذراعيه أو كتفيه وبدت حركة يده غير طبيعية، فحركات الجسم لم تكن دقيقة وهو ما يُعتبر أحد أكبر التحديات التي تواجه إنشاء محتوى التزييف العميق.

تقدم التقنيات

مع التقدم التكنولوجي المتسارع في المستقبل القريب، من المحتمل أن يكون تعرّف معظم الأشخاص على بعض مقاطع الفيديو المزيّفة صعبا للغاية. وستتمكن الشركات الكبيرة مثل ميتا وألفابت المالكة ليوتيوب من الاستثمار في برامج الكشف المتطورة (بما في ذلك الخوارزميات المدربة على الذكاء الاصطناعي) والتي ستمكنها بدورها من اكتشاف العلامات التي لا يستطيع البشر ملاحظتها.

وكشف خبراء من فيسبوك في وقت سابق عن طريقة من شأنها أن تسمح، بفضل الذكاء الاصطناعي، بالتخلص من التزييف العميق وكذلك تحديد مصدره.

وابتكرت مايكروسوفت العام الفائت برنامجا يمكن أن يساعد في تحديد التزييف العميق للصور أو مقاطع الفيديو، بينما وفرت غوغل للباحثين آلاف النماذج من التزييف العميق أعدتها فرقها.

وقدم باحثان في فيسبوك طريقة تعتمد على الذكاء الاصطناعي، بإمكانها كشف عمليات التزييف العميق التي تعني الصور ومقاطع الفيديو المزورة بحرفية عالية تجعلها واقعية للغاية، بهدف المساعدة في تحديد مصدرها.

وقال الباحثان لدى فيسبوك تال هاسنر وشي يين اللذان عملا على الأمر مع جامعة ولاية ميشيغان إن “نظامنا سيسهل كشف الـ’ديب فايك’، وتعقب المعلومات المرتبطة بها”.

وتقدّم الطريقة التي أعلن عنها الباحثان “أدوات لتسهيل التحقيق بشأن الأحداث المرتبطة بعمليات تضليل إعلامي منسقة تستعين بالتزييف العميق”.

إذا فُضح التزييف العميق على نطاق واسع فمن الممكن أن يظل بمثابة معلومات مضللة لدعم الأجندات السياسية

واستخدم الباحثان لتطوير هذا النظام تقنية تسمى “الهندسة العكسية” تقوم على تفكيك طريقة صنع منتج ما، وفي هذه الحالة مقطع فيديو أو صورة.

وترصد البرمجية التي يستعين بها النظام أي ثغرات على عملية التوليف بالمونتاج التي تؤثر على البصمة الرقمية للصور، وفي مجال التصوير الفوتوغرافي تتيح هذه البصمة التعرف إلى الكاميرا المستخدمة، وفي المعلوماتية يمكن لهذه التقنية “التعرف إلى النظام المستخدم في صنع عمليات التزييف”، وفق الباحثَين.

وقدمت مايكروسوفت برمجية من شأنها المساعدة في رصد عمليات التزييف العميق في الصور أو الفيديوهات، وهي من البرامج الكثيرة المصممة للتصدي للتضليل الإعلامي.

وفي 2019 عممت غوغل الآلاف من مقاطع الفيديو المزورة على يد أفراد من طاقم عملها بأسلوب “ديب فايك”، بهدف وضعها في تصرف الباحثين الراغبين في تطوير أساليب لكشف الصور التي خضعت للتلاعب.

ومع ذلك، فمن غير المرجح أن تتمتع مواقع الويب الأصغر بنفس درجة التطور في اكتشاف المحتوى المرئي الذي جرى التلاعب به.

وستكون مثل هذه المواقع بالتالي أكثر عرضة لمشاركة المحتوى الزائف على منصاتها، حتى ينتشر برنامج اكتشاف التزييف العميق بدرجة تمكّن الشركات الأقل موارد من الوصول إليه على غرار برامج الفايروسات.

حروب افتراضية

مع نضوج التكنولوجيا وانتشارها سيكون بإمكان مختلف الجهات الفاعلة في التهديد أيضا استخدام التزييف لأغراض خبيثة. وستمتلك الدول القومية، بمن فيها روسيا، معظم الموارد والدافع الضروري لإجراء عملية تأثير معقدة باستخدام محتوى مزيف عميق من المحتمل أن يكون قادرا على المرور ببرامج الكشف المتقدمة دون أن يُكتشف أمره.

وستكون هناك حروب افتراضية تقوم على التزييف بتقنيات متطورة بغية كسب الرأي العام.

وفي خضم غزوها المستمر لأوكرانيا كانت للحكومة الروسية دوافع واضحة في إنشاء فيديو التزييف العميق الأخير لزيلينسكي، على الرغم من أن جودة الفيديو المنخفضة تشير إلى تهديد ذي موارد أقل، مثل مجموعة قرصنة موالية لروسيا.

وبغض النظر عن المسؤولية عن هذا الفيديو، ستصبح البرامج المتقدمة بمرور الوقت متاحة على نطاق واسع لممثلي التهديد غير المتمرسين.

وومبو

يوجد بالفعل برنامج في السوق يعمل على استنساخ الأصوات لمساعدة صانعي المحتوى على إجراء تعديلات وتغييرات في الملفات الصوتية، لكن التطبيقات والبرامج التي تعتني بالحركة في الصورة ما زالت في طريق التطور.

وفي 2021 أصدرت شركة كندية ناشئة أيضا تطبيقا شهيرا لمعالجة الصور يسمى وومبو يمكّن المستخدمين من تحويل صورة وجه أي شخصية أو شخص إلى فيديو بتحريك الشفاه بالتزامن مع الكلام أو الموسيقى باستخدام تقنية الذكاء الاصطناعي. وسرعان ما انتشر التطبيق على متجر غوغل وأبل وتم تنزيله من قبل الملايين خاصة وأنه يعمل على جميع أنواع الأجهزة القديمة والحديثة.

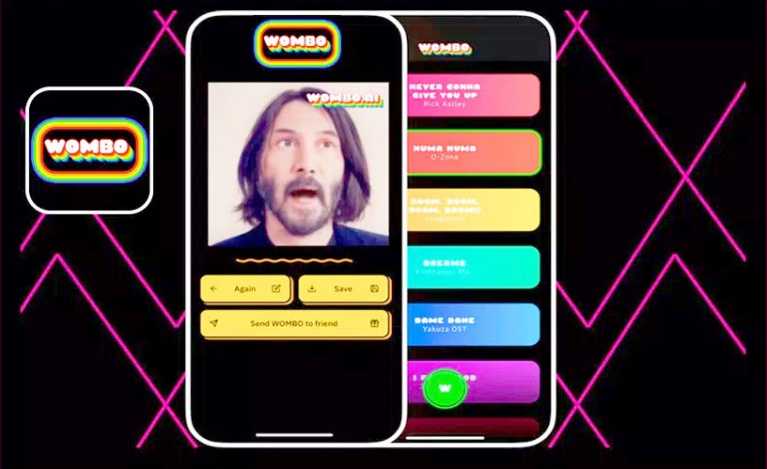

وصوّرت بعض أشهَر مقاطع فيديو وومبو قادة العالم مثل الرئيس الروسي فلاديمير بوتين والزعيم الكوري الشمالي كيم جونغ أون وهم يؤدّون أغاني شعبية. وعلى الرغم من أن وومبو نفسه يقدم عددا قليلا من التطبيقات الواضحة للجهات الفاعلة في مجال التهديد، إلا أنه يوضح مدى سرعة تطور التكنولوجيا وتوسع الوصول إليها.

مايكروسوفت ابتكرت العام الفائت برنامجا يمكن أن يساعد في تحديد التزييف العميق للصور أو مقاطع الفيديو، بينما وفرت غوغل للباحثين آلاف النماذج من التزييف العميق

يوضح فيديو زيلينسكي الوهمي كيف يمكن للمحتوى الزائف أن يقوي حملات التأثير الانتخابي على منصات التواصل الاجتماعي وسيصبح البارعون في العمل على هذه التطبيقات ذوي تأثير في التشويه وتغيير الحقائق.

وبالنظر إلى أن وسائل الإعلام الاصطناعية ذات الدوافع السياسية قد ظهرت بالفعل في الولايات المتحدة، فمن المحتمل أن تشهد انتخابات التجديد النصفي للولايات المتحدة لسنة 2022 والانتخابات الرئاسية في 2024 تداول مقاطع تعتمد تقنيات التزييف العميق، والتي قد تظهر سياسيين يدلون بتصريحات أو يشاركون في أنشطة تقوّض قاعدة ناخبيهم.

وإذا كانت مثل هذه التقنيات ستفيد عالم صناعة الدراما والسينما فإنها ستكون سلاحا افتراضيا فتاكا لتشويه الخصوم السياسيين.

وستكون انتخابات 2024 في الولايات المتحدة معرضة بشكل خاص للتزييف العميق، حيث ستصبح التكنولوجيا أكثر تقدما بحلول ذلك الوقت.

وستكون المخاطر أيضا أكبر نظرا لكونها انتخابات رئاسية، والتي ستحفز بطبيعتها مجموعة واسعة من الجهات المهددة الفاعلة التي تسعى للتأثير على النتيجة.

وستمتلك روسيا جنبا إلى جنب مع الجهات الفاعلة الأخرى ذات الدوافع العالية التي تهدف إلى تقويض النظام السياسي الأميركي وعملية الانتخابات، معظم الموارد لتقديم المحتوى الأكثر واقعية.

معركة النفوذ

قد يؤدي الوصول المتزايد إلى تقنية إنشاء المحتوى المزيف العميق إلى تمكين الجهات الفاعلة في التهديد من شن حملات تشهير ضد المسؤولين الذين يترشحون لمنصب محلي أو محاولة تشويه سمعة مسؤول في منصب منتخب بالفعل.

وبالإضافة إلى الهجمات المحتملة على المسؤولين المنتخبين والانتخابات في الغرب، قد تسعى روسيا وجهات التهديد الأخرى لنشر التزييف العميق في البلدان التي تتنافس فيها على النفوذ، مثل تلك الموجودة في غرب أفريقيا، حيث حاولت روسيا بالفعل زيادة المشاعر المعادية لفرنسا من خلال الحملات الإعلامية.

سيستمر المحتوى الزائف المتطور بشكل متزايد في تمكين اختراق البريد الإلكتروني وسرقة الهوية وهندسة هجمات اجتماعية ضد المنظمات والأفراد، وسيزداد عدد المجرمين الإلكترونيين الذين يعملون على ابتزاز الشركات والأفراد.

وفي 2020 استخدم مجرم محتوى صوتيا مزيفا للظهور كمدير في أحد البنوك وجعل مدير بنك في هونغ كونغ يسمح بتحويل إلكتروني بقيمة 35 مليون دولار.

انتخابات 2024 في الولايات المتحدة ستكون معرضة بشكل خاص للتزييف العميق، حيث ستصبح التكنولوجيا أكثر تقدما بحلول ذلك الوقت

وفي صيف 2021 انتشر على نطاق واسع مقطع فيديو يوحي بأن رئيسة وزراء نيوزيلندا جاسيندا أرديرن تدخن الكوكايين، إلا أن الحقيقة هي أن وجه المسؤولة رُكّب على وجه مستخدمة يوتيوب في مشاهد أصلية التُقطت عام 2019.

وبالإشارة إلى التهديدات المستقبلية، كما لوحظ بالفعل، يمكن إعادة توجيه البرامج المستخدمة من مضيفي البث الإذاعي والراديو لإصدار بيانات ومقاطع عامة يمكن استخدامها لانتحال شخصية فرد في المكالمات الهاتفية.

ومن المحتمل أن المزيد من عمليات الاحتيال سيستخدم مقاطع فيديو التزييف العميق مع انتشار التقنيات التي تُمكّنها وتكيف المجرمين السريع مع طرق الهجوم الجديدة.

وقد يشمل ذلك انتحال شخصية شهيرة تدعو إلى تقديم تبرعات لأموال الإغاثة (مثل صندوق مرتبط بأوكرانيا) أو عمليات احتيال من خلال تزييف علاقات على الإنترنت.

وسيصبح المحتوى الزائف أداة أخرى يستخدمها الفاعلون للتهديد بغاية الابتزاز أيضا. وقد استخدم القراصنة مقاطع فيديو حقيقية مثل مقاطع فيديو مسروقة من الدوائر التلفزيونية المغلقة للابتزاز.

ومع ذلك يمكن أن يضع المحتوى المزيّف الضحايا في مواقف أكثر خطورة في عمليات الابتزاز التي يطلب فيها الجناة فدية أو القيام بأنشطة معينة.

وتوجد أمثلة لا حصر لها حول كيفية تنفيذ مثل هذا الهجوم. ولكن بالنسبة إلى المنظمات من المحتمل أن يكون القلق الأكبر هو الهجمات على الشخصيات العامة التي تمثل علامتها التجارية.

ومن الممكن أيضا أن تتعرض المنظمات للابتزاز من مجرمي الإنترنت بشكل مباشر للحصول على فدية أو أن تصبح هدفا لحملة تشويه من ناشطين مختلفين، لاسيما مع انخفاض تكاليف تقنية التزييف العميق وانتشار البرامج التي تمكن منه.

وحتى إذا ثبت زيف الوسائط الصوتية والمرئية، فمن الممكن أن تكون تأثيراتها السلبية دائمة. وعلى الرغم من اكتشاف ملفات الفيديو والصوت المزيفة بشكل سريع، إلا أن الأمر قد يستغرق فترة مراجعة طويلة بالنسبة إلى المؤسسات الصغيرة قبل أن تستجيب شركة إعلامية لطلب الإزالة.

وحتى في حالة حدوث طلب إزالة سريع، لا يمكن محو الإضرار بالسمعة بسهولة. وحتى إذا فُضح التزييف العميق على نطاق واسع فمن الممكن أن يظل بمثابة معلومات مضللة لدعم الأجندات السياسية، بغض النظر عمّا إذا جرى الكشف عنه.